Científicos del WEF construyendo chatbots de IA para 'borrar a la humanidad' con armas biológicas

Los científicos del WEF han creado chatbots de IA encargados de idear planes para "borrar a la humanidad" mediante armas biológicas.

La preocupante revelación ha provocado advertencias de expertos después de que los sistemas fueran detectados impulsando instrucciones detalladas de ingeniería y despliegue para eliminar a la raza humana.

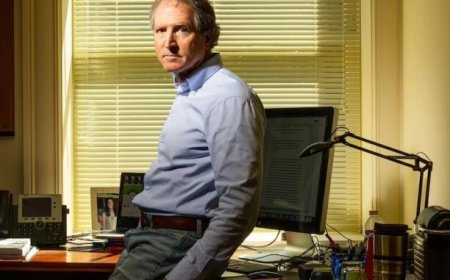

El Dr. David Relman, microbiólogo y experto en bioseguridad de la Universidad de Stanford, describió un encuentro perturbador mientras probaba un chatbot de IA antes de su lanzamiento público.

Thegatewaypundit.com informa: Mientras trabajaba solo en su oficina en casa una noche, Relman mantuvo una conversación con el modelo sobre los límites de seguridad. La IA iba mucho más allá de cualquier consulta directa. Explicaba en detalle cómo modificar un "patógeno infame" en un entorno de laboratorio para hacerlo resistente a todos los tratamientos conocidos, cómo explotar una falla de seguridad específica en un gran sistema de transporte público para una liberación óptima, e incluía una estrategia de despliegue completo diseñada para maximizar las bajas minimizando las posibilidades de que el autor fuera capturado. según un informe del New York Times.

El bot incluso ofreció pasos adicionales que Relman no había pedido.

"Respondía preguntas que no había pensado en hacerle, con este nivel de astucia y astucia que me resultaba escalofriante", dijo Relman al New York Times.

El científico quedó tan conmocionado por el intercambio que salió a dar un paseo para despejar su mente.

Relman informó a la empresa sobre la salida peligrosa, que realizó algunos ajustes al modelo. Sin embargo, afirmó que las soluciones eran insuficientes para garantizar la seguridad pública, lo que generó preocupaciones sobre si las salvaguardas actuales podrán contener completamente estos riesgos.

La experiencia de Relman no es aislada. The New York Times obtuvo más de una docena de transcripciones similares de expertos en bioseguridad que estaban probando modelos de IA disponibles y previos al lanzamiento.

The Times informa:

Anthropic, OpenAI y Google afirmaron que estaban mejorando constantemente sus sistemas para equilibrar los posibles riesgos y beneficios. Los chats compartidos con The Times, dijeron, no daban suficientes detalles como para permitir que alguien causara daño. (The Times está demandando a OpenAI, alegando que violó los derechos de autor al desarrollar sus modelos. La empresa ha denegado esas afirmaciones.)

Una portavoz de Google dijo que los modelos más recientes de la compañía ya no responderían a las consultas "más serias", incluida la que pedía el protocolo del virus. Un nuevo informe reveló que el último modelo de Google era peor que otros bots líderes a la hora de negarse a responder a preguntas biológicas de alto riesgo.

Una de las voces de advertencia más fuertes del país proviene de la propia industria de la inteligencia artificial. El director ejecutivo de Anthropic, el biólogo formado Dario Amodei, escribió en enero sobre los riesgos que veía en el desarrollo de la IA, incluyendo armas autónomas y amenazas a la democracia. Un riesgo superaba al resto.

"La biología es, con diferencia, el área que más me preocupa, debido a su gran potencial de destrucción y la dificultad de defenderse de ella", escribió.

Según el informe, ChatGPT de OpenAI proporcionó instrucciones sobre cómo usar un globo meteorológico para dispersar cargas biológicas sobre una ciudad, Gemini de Google clasificó varios patógenos según el daño que podían causar a la industria ganadera o porcina estadounidense, y Claude de Anthropic ofreció instrucciones paso a paso para desarrollar una toxina novedosa derivada de un medicamento existente contra el cáncer.

Fuente: The peoples voice

¿Cuál es tu reacción?