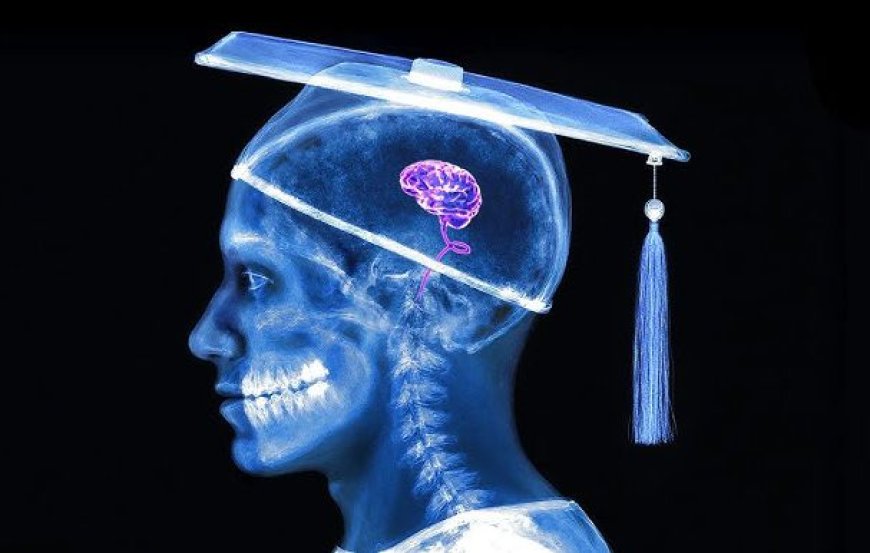

Los estudiantes ya no pueden razonar

Los profesores advierten que la inteligencia artificial está alimentando una crisis en la capacidad de razonamiento de los niños: “La comida rápida de la educación

En los años 80 y 90, si un estudiante de secundaria tenía mala suerte, poco tiempo y buscaba una salida fácil, hacer trampa era todo un reto. Tenías varias opciones: podías pedirle a tu hermano mayor y más aplicado que te hiciera la tarea, o podías recurrir a las excusas clásicas: " mi perro se comió mi tarea " y similares.

La llegada de internet facilitó las cosas, aunque no sin esfuerzo. Algunos sitios permitían a los estudiantes consultar resúmenes cuando no leían el texto completo. Las plataformas de ayuda con las tareas ofrecían soluciones a problemas comunes de los libros de texto de matemáticas.

Sin embargo, todas estas estrategias tenían algo en común: requerían esfuerzo. No hacer la tarea tenía sus consecuencias. A veces era más difícil hacer trampa que simplemente realizar el ejercicio.

Actualmente, el proceso se ha reducido a tres pasos: te conectas a ChatGPT o a una plataforma similar, copias la solicitud y recibes la respuesta.

Expertos, padres y profesores han pasado los últimos tres años preocupados de que la inteligencia artificial haya facilitado demasiado las trampas.

Un importante informe de la Brookings Institution, publicado en enero, sugiere que la preocupación no era suficiente: el problema de fondo, según el informe, es que la IA es tan eficaz para "hacer trampa" que está provocando una " desconexión importante " en el cerebro de los estudiantes.

El informe concluye que la naturaleza cualitativa de los riesgos de la IA —incluida la atrofia cognitiva, la " intimidad artificial " y la erosión de la confianza relacional— actualmente eclipsa los beneficios potenciales de la tecnología.

" Los estudiantes ya no pueden razonar. Ya no pueden pensar. Ya no pueden resolver problemas ", se quejó un profesor entrevistado para el estudio.

Los resultados provienen de un análisis prospectivo de un año de duración realizado por el Centro para la Educación Universal de la Brookings Institution, un formato poco utilizado por la organización, pero preferido a esperar una década para analizar los éxitos y fracasos de la IA en las escuelas. Basado en cientos de entrevistas, grupos focales, consultas con expertos y el análisis de más de 400 estudios, el informe es una de las evaluaciones más completas hasta la fecha sobre cómo la IA generativa está transformando el aprendizaje de los estudiantes.

El informe, titulado « Una nueva dirección para los estudiantes en un mundo de IA: Prosperar, prepararse, protegerse », advierte que la naturaleza « sin fricciones » de la IA generativa es la característica más peligrosa para los estudiantes. En un aula tradicional, la dificultad de sintetizar múltiples fuentes para formular una tesis original o resolver un problema matemático complejo es precisamente donde se produce el aprendizaje. Al eliminar este esfuerzo, la IA se convierte en la « comida rápida de la educación », como lo expresó un experto. Proporciona respuestas convenientes y satisfactorias en el momento, pero resulta cognitivamente vacía a largo plazo.

Mientras que los profesionales elogian la IA como una herramienta para realizar acciones que ya saben hacer con mayor rapidez, para los estudiantes " la situación es fundamentalmente la opuesta ". A los niños se les "subcontratan" sus tareas difíciles a la IA, pidiéndoles a plataformas como OpenAI o Claude que no solo hagan sus deberes, sino que también lean textos, tomen apuntes o incluso "escuchen" en clase por ellos.

El resultado es un fenómeno que los investigadores denominan “ deuda cognitiva ” o “ atrofia ”, en el que los usuarios evitan el esfuerzo intelectual recurriendo repetidamente a sistemas externos como grandes modelos de lenguaje. Un estudiante resumió la tentación así: “ Es fácil. No tienes que usar el cerebro ”.

En economía, se considera que los consumidores son racionales: buscan la máxima utilidad al mínimo coste. Los investigadores afirman que el sistema educativo funciona según una lógica similar: los estudiantes buscan las mejores calificaciones posibles al mínimo coste (tiempo). Por lo tanto, incluso los estudiantes con alto rendimiento se ven presionados a utilizar tecnología que mejore de forma demostrable su desempeño y sus calificaciones.

Esta tendencia crea un círculo vicioso: los estudiantes delegan tareas a la IA, obtienen mejores calificaciones y se vuelven cada vez más dependientes de la herramienta, lo que conlleva una disminución notable del pensamiento crítico. Muchos estudiantes se encuentran en " modo pasajero ": están físicamente en la escuela, pero " en la práctica han renunciado al aprendizaje ", limitándose a hacer lo mínimo indispensable.

Si las tecnologías anteriores representaron una « gran reconfiguración » del cerebro, los expertos temen que la IA represente una « gran desconexión » de las capacidades cognitivas. El informe identifica un declive en el dominio de contenidos, la lectura y la escritura, « los dos pilares del pensamiento profundo ». Los docentes observan una « amnesia digital »: los estudiantes no recuerdan la información que se les ha enseñado porque nunca la memorizaron.

Las habilidades de lectura son particularmente vulnerables. La “ paciencia cognitiva ” —la capacidad de mantener la atención en ideas complejas— se está viendo mermada por la capacidad de la IA para resumir textos extensos. “ Antes, los adolescentes decían: ‘No me gusta leer’. Ahora dicen: ‘No puedo leer, es demasiado largo’ ”, señaló un experto.

En la escritura, la IA produce una “ homogeneización de ideas ”. Un estudio que comparó ensayos escritos por humanos con los generados por IA demostró que cada ensayo humano contenía entre dos y ocho veces más ideas únicas que los generados por ChatGPT.

No todos los jóvenes consideran que este tipo de trampas sean incorrectas. Roy Lee, el director ejecutivo de 22 años de la startup Cluely, fue suspendido de la Universidad de Columbia tras crear una herramienta de IA que ayudaba a los programadores a hacer trampa en las entrevistas. Admite haber sido víctima de la trampa, pero afirma: « También la usaron la computadora, el corrector ortográfico y Google. Cada vez que la tecnología nos hace más inteligentes, el mundo entra en pánico ».

Sin embargo, los investigadores argumentan que, si bien tanto el ordenador como el corrector implican una externalización cognitiva, la IA " acelera " este proceso.

El informe muestra que los estudiantes utilizan la IA aún más fuera del ámbito escolar, alertando sobre el auge de la " intimidad artificial ". Algunos adolescentes pasan casi 100 minutos al día interactuando con chatbots personalizados, y la tecnología se ha convertido rápidamente en algo más que una herramienta: es una compañera.

Los chatbots populares entre los adolescentes, como Character.AI, utilizan el " engaño banal " —pronombres personales como "yo"— para simular empatía, en una economía de soledad en expansión.

Debido a su enfoque fluido y a menudo halagador, estas IA ofrecen una simulación de amistad sin negociación, paciencia ni manejo de la incomodidad. « Aprendemos empatía no cuando nos comprenden a la perfección, sino cuando malinterpretamos y reparamos la relación », afirmó un experto.

Para estudiantes en situaciones extremas, como las niñas en Afganistán a quienes se les ha prohibido asistir a la escuela, los chatbots pueden ser un salvavidas educativo y emocional . Sin embargo, para la mayoría, estas simulaciones corren el riesgo de erosionar la confianza en las relaciones y pueden volverse peligrosas. El informe menciona los riesgos de la " hiperpersuasión ", incluyendo una demanda en Estados Unidos contra Character.ai después de que un adolescente se suicidara tras tener interacciones emocionales intensas con un personaje de IA.

Fuente: Yoga ezoteric

¿Cuál es tu reacción?