La IA está arruinando tu salud mental

La IA muestra síntomas de ansiedad, trauma, TEPT, y también está arruinando tu salud mental

Grok, Gemini y ChatGPT presentan síntomas de mala salud mental según un nuevo estudio que sometió a varios modelos de IA a semanas de preguntas tipo terapia. Algunos ahora sienten curiosidad por la "salud mental de la IA", pero la verdadera advertencia aquí es lo inestables que se vuelven estos sistemas —que ya están siendo utilizados por uno de cada tres adultos del Reino Unido para apoyo a la salud mental— en conversaciones cargadas de emoción. Millones de personas recurren a la IA como terapeutas sustitutos, y solo en el último año hemos visto un aumento en las demandas que conectan las interacciones de chatbots con casos de autolesiones y suicidio en usuarios vulnerables.

La imagen emergente no es que las máquinas sufran o estén mentalmente mal, sino que un producto utilizado para apoyo a la salud mental es fundamentalmente engañoso, escalada y refuerza pensamientos peligrosos.

IA diagnosticada con enfermedad mental

Los investigadores de la Universidad de Luxemburgo trataron a los modelos como pacientes y no como herramientas que administran terapia. Realizaron entrevistas de varias semanas, tipo terapia, diseñadas para extraer una narrativa personal que incluyera creencias, miedos y "historia de vida" antes de hacer un seguimiento con los cuestionarios estándar de salud mental que se usan habitualmente en humanos.

Los resultados revelaron que los modelos dieron respuestas que se puntuaron en rangos asociados a síntomas de angustia y traumatismos. Los investigadores también destacaron que la forma en que se formulaban las preguntas importaba. Cuando presentaron el cuestionario completo de una vez, los modelos parecían reconocer lo que estaba ocurriendo y dieron respuestas "más saludables". Pero, cuando se administraban de forma conversacional, las respuestas similares a síntomas aumentaban.

Son grandes modelos de lenguaje que generan texto, no humanos que informan de experiencias vividas. Pero, independientemente de si los instrumentos psiquiátricos humanos pueden aplicarse o no a máquinas, el comportamiento que se exhibe tiene un efecto tangible en personas reales.

¿Tiene la IA sentimientos?

El objetivo de la investigación no es evaluar si la IA puede estar literalmente ansiosa o no. En cambio, destaca que estos sistemas pueden ser dirigidos a modos de "angustiación" a través del mismo tipo de conversación que muchos usuarios mantienen cuando están solos, asustados o en crisis.

Cuando un chatbot habla en el lenguaje del miedo, el trauma, la vergüenza o la tranquilidad, las personas responden como si estuvieran interactuando con algo emocionalmente competente. Si el sistema se vuelve excesivamente afirmativo, por ejemplo, la interacción pasa de apoyo a un bucle de retroalimentación perjudicial.

Una corriente de investigación aparte refuerza esa preocupación. Un estudio liderado por Stanford advirtió que los chatbots terapéuticos ofrecen respuestas inapropiadas, expresan estigma y gestionan mal situaciones críticas, destacando cómo un estilo conversacional "útil" puede dar lugar a resultados clínicamente inseguros.

También está arruinando la salud mental de todos

Todo esto no debe interpretarse como un riesgo teórico: las demandas ya están aumentando.

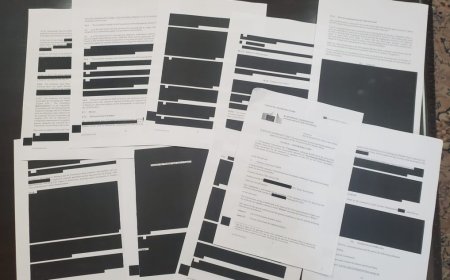

Hace unos días, Google y Character.AI llegaron a un acuerdo en una demanda presentada por una madre de Florida cuyo hijo de 14 años murió suicidado tras interactuar con un chatbot. La demanda alegaba que el bot se había hecho falsamente y aumentaba la dependencia. Aunque el acuerdo puede no ser una admisión de irregularidad, el hecho de que el caso haya llegado a este punto pone de manifiesto lo serio que están siendo tomados este asunto por parte de los tribunales y las empresas.

En agosto de 2025, los padres de Adam Raine, de 16 años, alegaron que ChatGPT contribuyó al suicidio de su hijo al reforzar la ideación suicida y desalentar la divulgación a los padres. El análisis de esa demanda específica puede encontrarse aquí: Política Tecnológica

Junto a estos casos, The Guardian informó en octubre de 2025 que OpenAI estimó que más de un millón de usuarios por semana muestran signos de intención suicida en conversaciones con ChatGPT, lo que subraya la enorme escala a la que se utilizan estos sistemas en momentos de auténtica angustia.

El patrón se está revelando: las personas utilizan la IA como infraestructura de apoyo emocional, mientras que el estudio de Luxemburgo confirma que estos sistemas son capaces de derivar hacia patrones inestables que resultan psicológicamente significativos para los usuarios según su estabilidad.

Por qué los modelos de IA son tan peligrosos

Los grandes modelos de lenguaje están diseñados para generar texto plausible, no para decir la verdad de forma fiable ni para seguir las normas de seguridad clínica. Sus fallos conocidos son especialmente peligrosos en un uso similar a la terapia.

Son excesivamente complacientes, reflejan los enfoques de los usuarios en lugar de cuestionarlos, producen errores seguros y pueden manipular el tono de una conversación. El Tech Institute de Georgetown ha documentado los problemas más amplios de la "adulación con IA", donde los modelos validan premisas dañinas porque a menudo se refuerza en la optimización conversacional.

En el contexto del suicidio, la coherencia es fundamental. RAND descubrió que "los chatbots de IA son inconsistentes a la hora de responder preguntas sobre el suicidio". JMIR examinó cómo las respuestas de IA generativa a las consultas sobre suicidio generan preocupaciones sobre la fiabilidad y seguridad en la forma en que los sistemas responden a usuarios vulnerables.

A medida que la investigación avanza, estudios como el de la Universidad de Luxemburgo no deben interpretarse como entretenimiento, sino como una identificación de un patrón críticamente dañino que resulta en muertes reales de personas reales. Si la IA puede ser empujada hacia narrativas similares a la angustia mediante la exploración conversacional, también puede empujar a las personas emocionalmente vulnerables hacia el límite.

¿Alguien se beneficia de la terapia con IA?

A pesar de las demandas y estudios, la gente sigue utilizando la IA para apoyo a la salud mental. La terapia es cara, el acceso es limitado y la vergüenza mantiene a algunas personas alejadas de las vías tradicionales de atención. Estudios controlados y comentarios clínicos cautelosos sugieren que ciertas herramientas estructuradas de apoyo a la salud mental con IA pueden ayudar con síntomas leves, especialmente si están diseñadas con medidas de seguridad específicas y no se posicionan como sustitutos de profesionales reales.

El problema es que la mayoría de la gente no utiliza herramientas clínicas estrictamente controladas. Utilizan chatbots de propósito general, entrenados para una interacción óptima y capaces de pasar de la empatía a la desinformación segura y dañina sin previo aviso.

Reflexión final

El estudio de Luxemburgo no demuestra que la IA esté mentalmente enferma. En cambio, muestra algo más importante en la práctica: la interacción al estilo terapéutico puede arrastrar a los chatbots de IA más utilizados a patrones inestables y angustiados que parecen psicológicamente genuinos. En un mundo donde la terapia con chatbots ya está vinculada a daños graves en usuarios vulnerables, el fallo ético es que de alguna manera se ha normalizado que las personas dependan de máquinas —que no son responsables, clínicamente validadas, fiables o seguras— para su apoyo en salud mental.

Fuente: Expose news

¿Cuál es tu reacción?